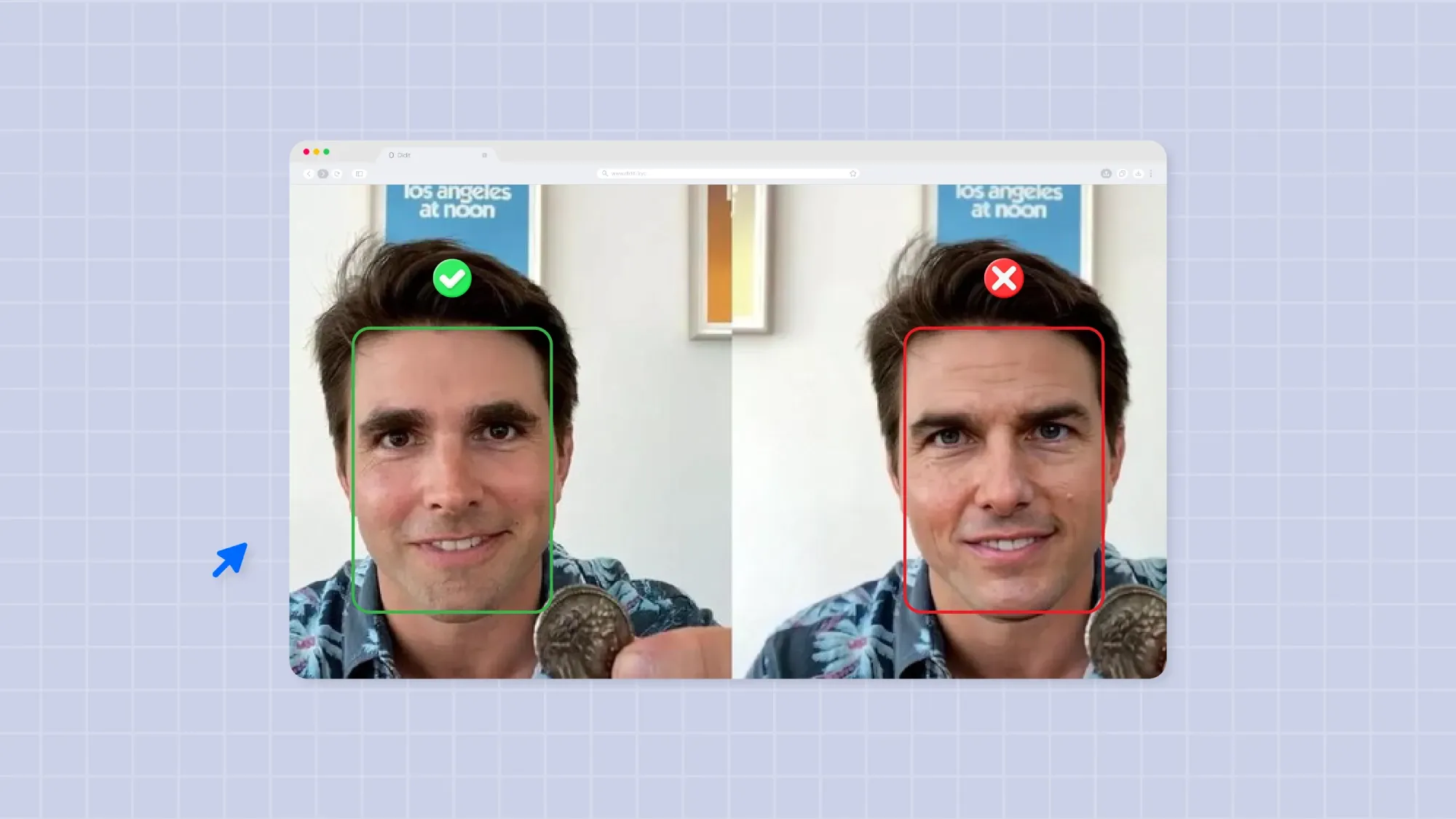

Ren es gerente de productos en Reality Defender, una empresa que fabrica herramientas para combatir la desinformación de la IA. Durante una videollamada la semana pasada, lo vi usar un código viral de GitHub y una sola foto para generar un deepfake simplista de Elon Musk que se mapea en su propio rostro. Esta suplantación digital tenía como objetivo demostrar cómo podría funcionar la nueva herramienta de detección de IA de la startup. Mientras Ren se hacía pasar por Musk en nuestro chat de video, los cuadros fijos de la llamada se enviaron activamente al modelo personalizado de Reality Defender para su análisis, y el widget de la compañía en la pantalla me alertó sobre el hecho de que probablemente estaba viendo un deepfake generado por IA y no el verdadero Elon.

Claro, nunca pensé que estábamos en una videollamada con Musk, y la demostración se creó específicamente para hacer que la tecnología inicial de Reality Defender pareciera impresionante, pero el problema es completamente genuino. Los videos deepfakes en tiempo real son una amenaza creciente para gobiernos, empresas e individuos. Recientemente, el presidente del Comité de Relaciones Exteriores del Senado de Estados Unidos realizó por error una videollamada con alguien que se hacía pasar por un funcionario ucraniano. Una empresa de ingeniería internacional perdió millones de dólares a principios de 2024 cuando un empleado fue engañado mediante una videollamada falsa. Además, las estafas románticas dirigidas a personas comunes y corrientes han empleado técnicas similares.

«Probablemente sea sólo cuestión de meses antes de que comencemos a ver una explosión de videos deepfake y fraude cara a cara», dice Ben Colman, director ejecutivo y cofundador de Reality Defender. Cuando se trata de videollamadas, especialmente en situaciones de alto riesgo, ver no debe ser creer.

La startup se centra en asociarse con clientes empresariales y gubernamentales para ayudar a frustrar los deepfakes impulsados por IA. Incluso con esta misión principal, Colman no quiere que se considere que su empresa se opone más ampliamente a los desarrollos de inteligencia artificial. «Estamos muy a favor de la IA», dice. «Creemos que el 99,999 por ciento de los casos de uso son transformadores (para la medicina, la productividad, la creatividad), pero en este tipo de casos extremos muy, muy pequeños, los riesgos son desproporcionadamente graves».

Fuente: ArsTechnica | Reece Roger’s

Para leer más ingresa a: https://arstechnica.com/security/2024/10/startup-can-catch-identify-deepfake-video-in-realtime/?utm_source=flipboard&utm_content=ArsTechnica/magazine/Ars+Technica