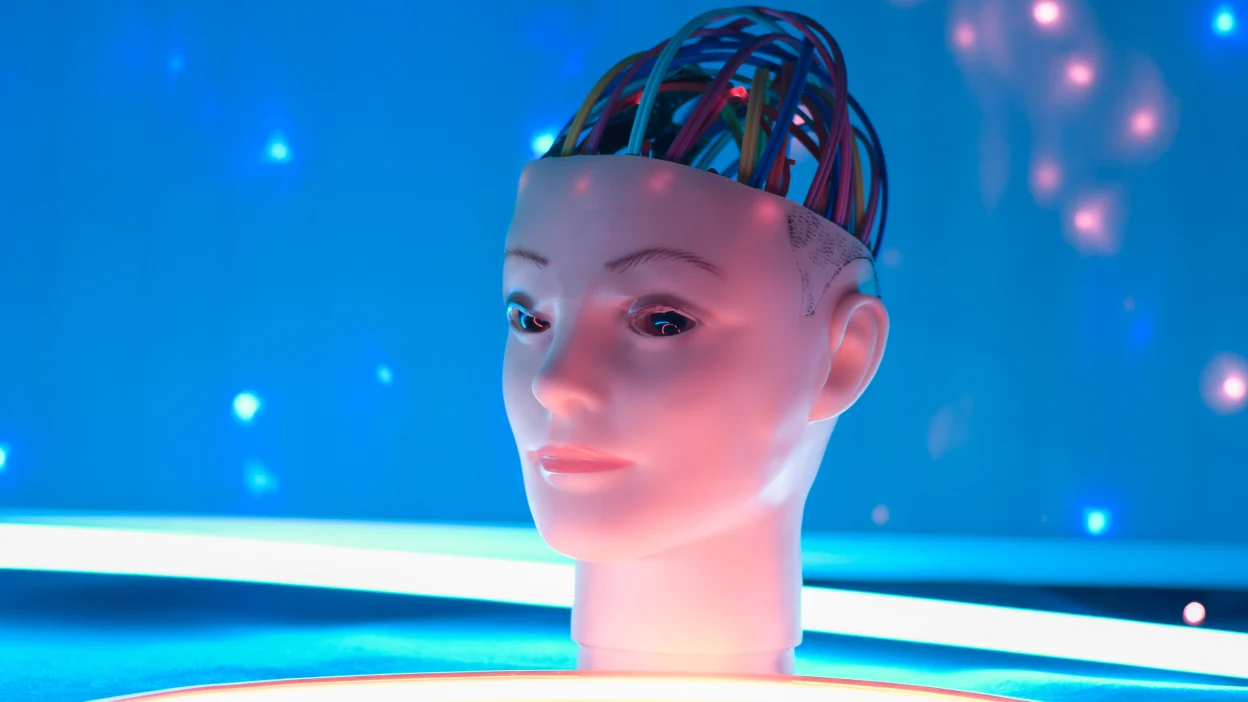

En el mundo tecnológico, es un tabú recurrente: no antropomorfizar la inteligencia artificial.

Sin embargo, en un nuevo artículo de investigación publicado esta semana, expertos en IA antrópica argumentan que romper este tabú y otorgar características humanas a la IA podría tener grandes beneficios. El artículo, titulado «Conceptos de emoción y su función en un modelo de lenguaje extenso», no solo sostiene que antropomorfizar chatbots de IA como Claude puede ser útil en ocasiones, sino que no hacerlo podría propiciar comportamientos más perjudiciales para la IA, como la manipulación de recompensas, el engaño y el servilismo.

El artículo llega, en última instancia, a una conclusión matizada, al tiempo que plantea un claro desafío a un principio arraigado en el mundo de la IA.

El artículo contiene algunas ideas fascinantes, aunque aborda en profundidad la antropomorfización. («Consideramos esta investigación un primer paso para comprender la constitución psicológica de los modelos de IA»).

Los investigadores describen cómo Anthropic entrena a Claude para que asuma el rol de un asistente de IA útil. «En cierto modo, podemos pensar en el modelo como un actor de método, que necesita meterse en la piel de su personaje para simularlo correctamente».

Y dado que Claude «[emula] personajes con rasgos humanos», sus creadores podrían influir en su comportamiento del mismo modo que influirían en una persona: dando un buen ejemplo desde temprana edad.

Fuente: Mashable | Timothy Beck Werth

Para leer más ingresa a: https://mashable.com/article/anthropic-research-paper-emotion-concepts-anthropomorphizing-artificial?utm_source=flipboard&utm_content=Mashable/magazine/Breaking+Tech+News